Innholdsfortegnelse:

- Forfatter John Day day@howwhatproduce.com.

- Public 2024-01-30 11:24.

- Sist endret 2025-01-23 15:02.

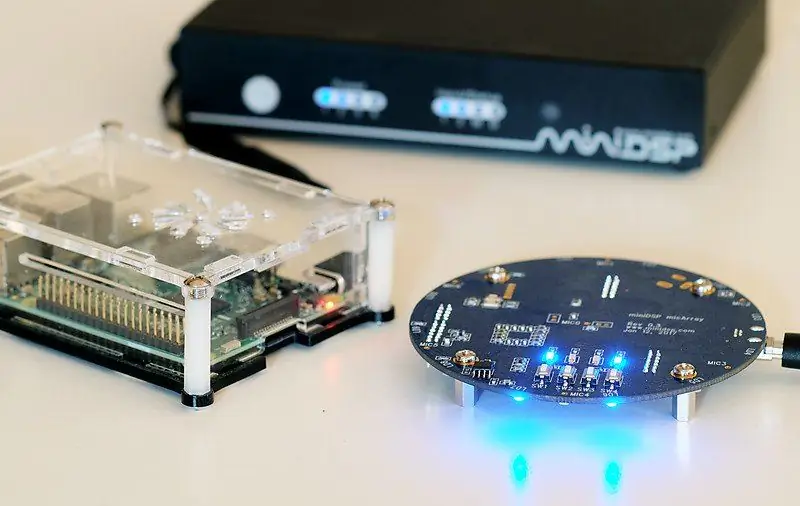

MiniDSP UMA-8 mikrofonoppsettet, med retningsdeteksjon ombord, ekkokansellering og støyreduksjon, har et bredt spekter av applikasjoner. I denne instruksen vil vi gjennomgå bruken med IBM Watsons tale-til-tekst-tjeneste for å kontrollere en LED-lanterne.

Hvorfor bruke UMA-8?

Alle stemmestyrte apparater krever en mikrofon for å fange lyd, og man kan si at du kan bruke en tilfeldig 2 dollar mikrofon. Dette er greit hvis du sitter ved datamaskinen, rett foran mikrofonen, men for "langt felt", håndfri kontroll er det nødvendig med en mer sofistikert mikrofon. UMA-8 har:

- Stråledannende kjører på tvers av en rekke 7 mikrofoner for å forbedre stemmegjenkjenning og eliminere uvedkommende lyder.

- Ekkokansellering og støyreduksjon for å redusere effekten av lyder uten tale (som musikkavspilling) og støy (trafikk, kjøkkenlyder osv.).

UMA-8 er "plug and play"-du trenger ikke å konfigurere noe for å få det til å fungere med RPi. Hvis du ønsker det, kan du imidlertid bruke miniDSP -pluginet til å justere behandlingsparametrene til mikrofonarrayet (anbefales kun for avanserte brukere!)

Trinn 1: Det du trenger

Det du trenger å HA

- 1 x Raspberry Pi 2 eller 3 sammen med en USB -strømforsyning for din Pi

- 1 x tastatur

- 1 x HDMI -skjerm

- En internettforbindelse

-

1 x liten LED -lanterne (~ $ 10)

- eBay -lenke

- AliExpress Link

-

Noen jumperkabler for kvinner og kvinner (~ $ 3)

- eBay -lenke

- AliExpress Link

-

1 x 2n2222 NPN -transistor (~ $ 3)

- eBay -lenke

- AliExpress Link

- 1 x loddejern (med lodding og varmekrymping) for å koble ledninger

-

1 x miniDSP UMA-8 USB-mikrofonarray

Kjøp direkte fra MiniDSP -nettstedet

- En IBM BlueMix -konto (se detaljer nedenfor for registrering)

Hva du trenger å vite

- Litt grunnleggende erfaring med Raspberry Pi -plattformen

- Noen grunnleggende Bash -ferdigheter (cd, ls, etc.)

- Grunnleggende ferdigheter i tekstredigerer i Nano (åpning og lagring)

- Et ivrig sinn, klar til å lære å lage en stemmestyrt lykt!

Trinn 2: Koble alt opp

La oss først koble opp utstyret vårt! Ta din Raspberry Pi og koble til tastaturet og HDMI -skjermen.

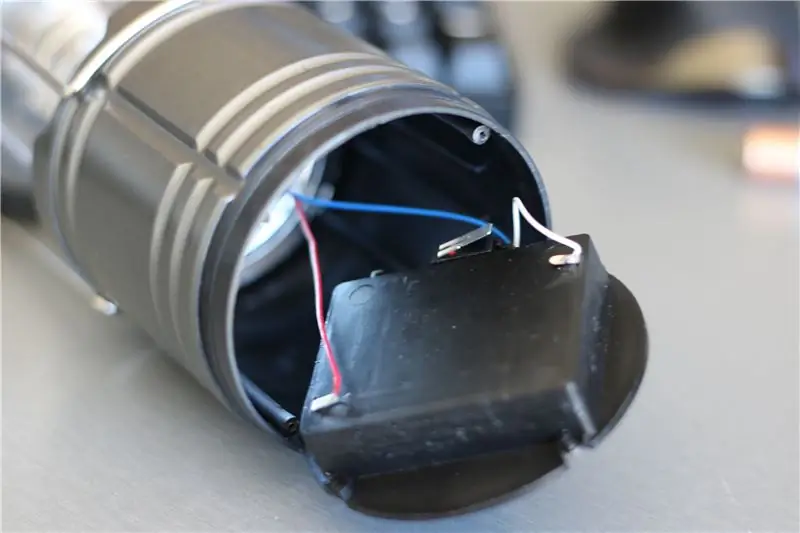

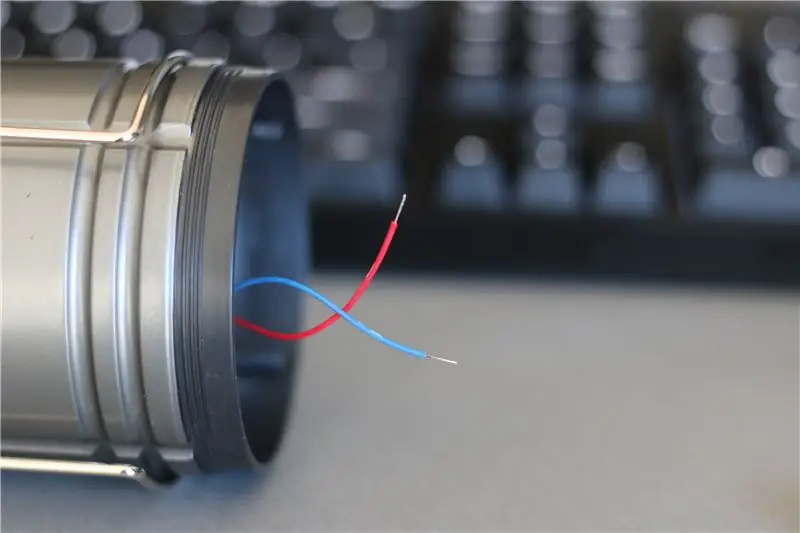

Nå må vi ta lykten fra hverandre for å avsløre dens strømledninger. Som du kan se, får du tilgang til de RØDE (5v) og BLÅ (GND) ledningene etter å ha fjernet de 4 skruene på batteriholderen. Alt vi trenger å gjøre for å slå lykten på eller av, er å sende 5v nedover disse ledningene!

Vi bruker en transistor til å sende denne spenningen og slå lykten på og av. Hvorfor ikke bare koble inngangen til lampen rett til RPi, spør du? Vel, dette er fordi RPi -kontrollpinnene (også kalt "GPIOer") ikke klarer å levere den strømmen vi trenger for å belyse lykten. Transistoren fungerer på lignende måte som et relé, som en elektronisk bryter som passerer strøm gjennom den når en spenning tilføres.

Vi vil veksle pinnen som er koblet til den lilla ledningen HIGH og LOW for å kontrollere transistoren som på sin side sender 5v nedover linjen til lykten. Transistoren må være kablet opp for å krysse den BLÅ (GND) ledningen for å fungere korrekt.

Vær nøye med diagrammene og bildene nedenfor når du kobler til lykten.

Vi loddet kvinnelige overskrifter til lyktens ledninger for å gjøre det lettere å koble dette til. Hvis du ikke har loddet før, kan du se på denne instruksen som gir en god forklaring.

Til slutt må du koble til strømmen og miniDSP UMA-8 USB Microphone Array, bare koble den til en USB-port! Det er alt som trengs, ettersom UMA-8 er plug & play med RPi.

Trinn 3: Klargjøre Pi

Før du slår på Pi, må du laste ned Raspbian Stretch LITE fra Raspberry Pi Foundation. Sørg for at du får LITE -versjonen som ikke inkluderer et skrivebord. Brenn det nedlastede bildet på et micro-SD-kort. Koble micro-SD-kortet til Pi og koble til strømmen. Du vil se skjermen eller TV -en komme med en påloggingsmelding.

For å logge på, bruk standard påloggingsdetaljer for Raspberry Pi.

Brukernavn: piPassword: bringebær

Hvis du har en Ethernet (kablet) internettforbindelse tilgjengelig, er du klar. Ellers må du konfigurere Wifi. Følg denne veiledningen for å konfigurere Wifi på din Pi.

Last ned og installer NodeJS

Installer først NodeJS ved hjelp av pakkebehandleren. Her er en praktisk guide som forklarer gjeldende kommandoer som kreves. I skrivende stund er dette kommandoene jeg brukte:

curl -sL https://deb.nodesource.com/setup_8.x | sudo -E bash -sudo apt -get install -y nodejs

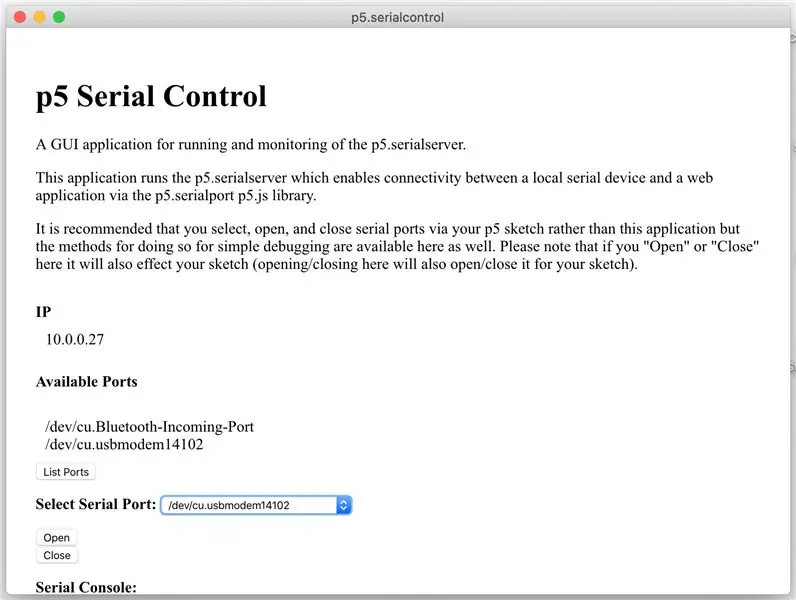

Deretter må vi installere programmet som NodeJS vil kjøre for å la lykten vår høre (via UMA-8) og kontrollere lampen (via GPIO-hodene). Last ned først depotet som inneholder koden: (hent ved å kopiere URL -adressen til zip -filen som er vedlagt dette trinnet)

wget https://cdn.instructables.com/ORIG/FBU/XWAG/J86HJLO9/FBUXWAGJ86HJLO9.zipunzip voice-light.zipcd voice-light

La oss nå installere alle de ekstra bitene og bobber som dette programmet krever for å kjøre:

npm installere

Når installasjonen er fullført, er du klar til å hoppe inn i IBM Watson.

Trinn 4: Konfigurering av IBM Watson

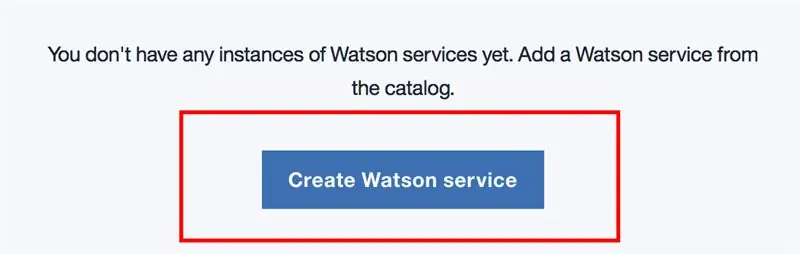

Nå som lykten er koblet til, kan vi begynne å jobbe med stemmegjenkjenning! Hvis du ikke allerede har gjort det, kan du registrere deg for IBM BlueMix. Når du er logget inn, navigerer du til BlueMix Services Dashboard.

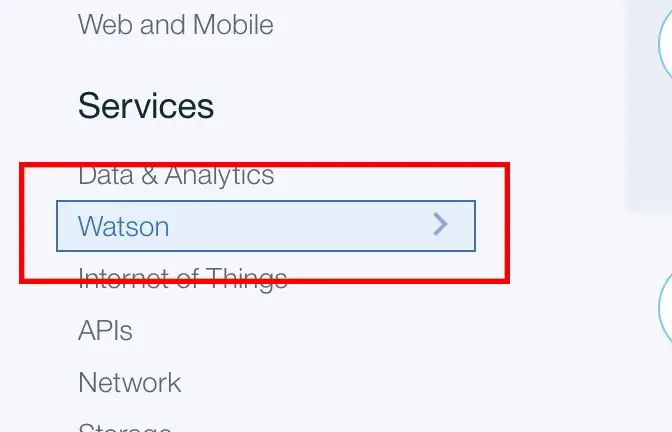

Klikk på den store "Create Watson service" -knappen i midten av skjermen. Se bilde 1.

Deretter vil du bli presentert med en katalog over alt tjenesten IBM BlueMix har å tilby. La oss hoppe til delen "Watson" i sidefeltet. Se bilde 2.

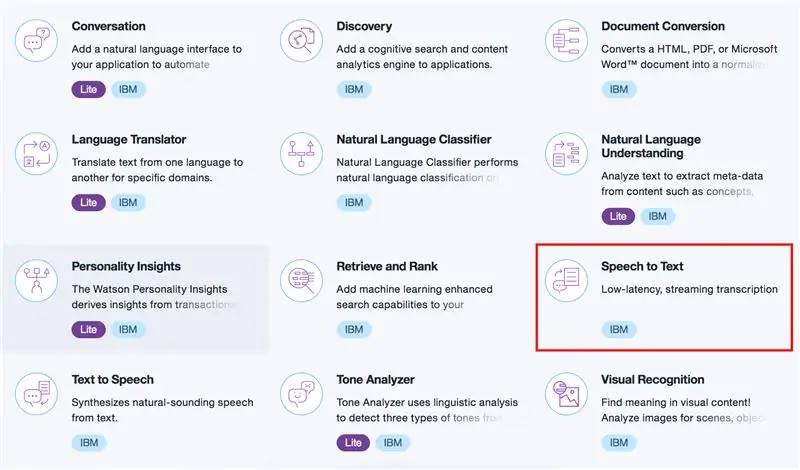

Vi må nå legge til "tale-til-tekst" -tjenesten. Dette vil tillate oss å sende en talestrøm til WATSON, og få den til å strømme tilbake tekst (konvertert fra innkommende lyd). Se bilde 3.

For å gjøre dette, klikk på flisen (skissert i rødt ovenfor). Når siden er lastet inn, kan vi forlate standardinnstillingene og velge "Opprett" -knappen nederst til venstre. Se bilde 4.

Til slutt må vi få "Tjenesteattest". Disse detaljene brukes av vår appvilje for å koble til Watson. Se bilde 5.

Klikk på "Vis legitimasjon" -knappen for å utvide flisen og kopier deretter linjene som inneholder "brukernavn" og "passord" til et tekstdokument på datamaskinen din. Vi trenger disse senere, så sørg for at de er tydelig merket som "WATSON Creds" eller lignende. Se bilde 6.

Trinn 5: Legge til våre WATSON -legitimasjon i appen

Nå som vi har fullført prosessen med å hente våre Watson -legitimasjoner, må vi gi lykten vår beskjed om hvordan vi logger på Watson. Hopp tilbake foran Pi og sørg for at du er i talelyskatalogen som inneholder appen. Vi må redigere “settings.js” -filen for å inkludere disse detaljene. Åpne filen med denne kommandoen:

nano settings.js

Nå, erstatt hver av innstillingene som er skissert i denne filen, med innstillingene du spilte inn tidligere.

Trinn 6: Kjøre vår stemmekontrollerte lanterne

Når appen din er konfigurert, er den klar til å kjøre!

For å slå på lykten, si “La det være lys!”, For å slå den av, si “La det være mørke!”. Hold øye med Raspberry Pi -konsollutgangen for å se hvordan WATSON tolker det du sier.

sudo node app.js

Anbefalt:

Magic Lantern: 6 trinn

Magic Lantern: Christiaan Huygens, pioneren innen projektorer, hadde utviklet den magiske lykten, som brukte et konkavt speil for å reflektere og lede så mye av lyset fra en lampe som mulig gjennom et lite glassark som bildet skulle projiseres på. gjorde

Wearable Light Up Jack-O-Lantern: 5 trinn (med bilder)

Wearable Light Up Jack-O-Lantern: Her er et flott 3D-trykt prosjekt å ta like før Halloween. Følg trinnene nedenfor for å gjøre deg selv til en Wearable Light Up 3D-trykt Jack-O-Lantern, som du kan bære rundt halsen, eller plassere på skrivebordet for å få deg i Hallowe

Sangfølger Led-blinkende Hack-O-Lantern !: 6 trinn

Sangfølger Led-blinkende Hack-O-Lantern !: Lag en jack-o-lanterne som spiller og blinker flerfargede lysdioder til alles favoritt Halloween-sang

Jack-o'-lantern´s Lantern: 3 trinn

Jack-o'-lantern´s Lantern: Dette er et prosjekt du enkelt kan gjøre hjemme med barn og familie i løpet av disse uhyggelige dagene! Den består i å tilføre lys til gresskaret ditt (det kan være et ekte eller kunstig), slik at du bokstavelig talt kan få en Jack-o´-lanternes lykt

LOL Thresh Lantern- Nattlys: 15 trinn

LOL Thresh Lantern- Night Light: Lampens design er basert på favorittspillet mitt, League of Legend. Denne lampen er et kult verktøy som hjelper Thresh med å hjelpe lagkameraten ved å bringe dem i sikkerhet. Lampen kan også gi lagkameratene et skadeblokkerende skjold. Jeg bestemmer meg for å lage dette