Innholdsfortegnelse:

- Forfatter John Day day@howwhatproduce.com.

- Public 2024-01-30 11:22.

- Sist endret 2025-01-23 15:02.

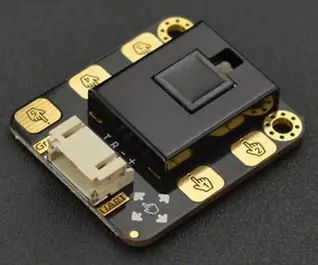

For et par dager siden fikk jeg en gestgjenkjenningssensor, som bildet viser. Brukt den i et par dager, jeg er ganske sikker på at denne Gravity: Gesture & Touch Sensor er et klassisk verk!

Gesterkjenning, som alltid kommer med sci-fi, kule egenskaper. Gestgjenkjenningsteknologien spiller en stor rolle i mange sci-Fi-blockbusters og arbeider om fremtiden. Med lidenskapen til å bøye knærne til denne typen futuristisk teknologi, mens jeg, etter å ha testet forskjellige sensorer for gjenkjenning av gester, bare finner den benete virkeligheten. Hjertet mitt er knust, hvordan kan det være så vanskelig å bruke? Jeg har prøvd 3 sensorer.

Det første problemet er unøyaktig anerkjennelse, selv om jeg håndhilser med en standardposisjon og vinker fremover, ville resultatet bli den rette anledningen.

Det andre problemet er for sakte, noe som er dødelig. Tenk deg at du har laget en lyskontroller med disse gestgjenkjenningssensorene, og du vil vise den frem for gjestene dine. Handlingen er ferdig, vel … ingenting skjedde, du og han / hun så på hverandre og tapte ord i sekunder. Til slutt lyser det … Så den gamle gestgjenkjenningssensoren kan ikke tilfredsstille mine krav. Helt til jeg møter engelen min.

Her vil jeg snakke om hvordan min ideelle gestgjenkjenning ser ut. Hvordan definerer jeg det?

Først og fremst er det en kontrollsensor, så den skal være pålitelig.

For kontroller er trykknapper vanlige å se i dagliglivet. For eksempel lysekronebryteren i stua, når den trykkes, vil lyset være PÅ/AV. Bryteren kan kontrollere lyset. Det samme som gestgjenkjenningssensoren skal gjenkjenne bevegelsene helt. Hvis jeg vinker opp 10 000 ganger, skal resultatet av gestgjenkjenningssensoren være 10 000 OPP, det må ikke være noe annet resultat. 10 000 UP -er betyr pålitelig, 9999 UP -er, men 1 annet resultat betyr upålitelig.

For det andre bør anerkjennelsen være rask. I eksempelet på et bryterlys ovenfor, hvis du tegner en gest, men sensoren må vente i 3 sekunder for å gjenkjenne den. Målet må være en søppelbøtte.

Når du tar massive arbeider for å gjøre det, men bare for å finne ut at det er så vanskelig å bruke, selv i forhold til den enkle lysbryteren på veggen. Hvordan kan det være? Meg, jeg blir sint. Det jeg ønsket var å gjøre sensorresponsen så snart bryteren styrer. Når jeg trykker på bryteren, vil signalet overføres til lys samtidig, hele rommet lyser.

Disse to punktene er enkle å tenke, for andre uklare funksjoner, la oss finne dem ut fra andre produkter: Sony Headphone WH-1000XM3.

Dette er et aktivt støyreduksjonshodesett. Men hva er aktiv støyreduksjon? Miljøstøy er også en slags lydbølge. Vi kan føle det når vi tar T -banen eller flyet. Når støyen når ørene våre og vibrerer trommehinnen, kan den høres av oss. Aktiv støyreduksjonsteknologi kan omtrent forstås slik at når støyen når støyen i hodetelefonene våre, analyserer den støydempende brikken den raskt og avgir en motsatt bølgeform umiddelbart. Vi vet alle at bølger har topper og trau. Når toppen møter trau, vil de kompensere hverandre. Derfor kan vi jevne ut støyen ved å avgi en motsatt bølge av støy.

Denne Sony-hodetelefonen WH-1000XM3 bruker denne typen elektrisk sensingteknologi, som også brukes i sensorer for bevegelsesgjenkjenning. La oss analysere dets samspillsprinsipp!

Ta funksjonen Venstre/Høyre: Bytt sang som et eksempel. Jeg vil sette fingeren min nær midten av øreklokken, og deretter flytte til høyre for å hoppe over sangen; Hvis jeg vil justere volumet, vil jeg også holde fingeren nær midten først og flytte den opp. Samspillet er godt designet.

Tenk deg at Sony-hodetelefonen WH-1000XM3 bruker gestgjenkjenningssensoren, og du vil hoppe over sangen etter bevegelser. Hvordan gjøre? Jeg må være forvirret. Hvor skal du begynne å tegne bevegelser? Og når skal det ta slutt? Ja, dette er poenget, som er det vanlige problemet med at nesten alle bevegelser gjenkjenner sensorer i markedet. Hvordan vet folk når og hvor de begynner å tegne effektive bevegelser? Når begynte sensoren å gjenkjenne bevegelser? Hvor er poenget å avslutte med å gjøre bevegelser? Disse skiltene er uklare, noe som betyr at de mangler klare og vanlige kontrollregler.

Tilbake til SONY -hodetelefonen, når du setter fingeren i øreklokke, noe som betyr starten på gjenkjenning, når fingeren beveger seg, gjenkjenner, når fingeren beveger seg til enden av øreklokken og går, noe som tyder på slutten av gjenkjennelsen. Da vil hodetelefonen svare riktig. Hele prosessen har hvert tegn, klart og godt arrangert. Akkurat som hvordan vi lærer å kjøre bil, vil treneren finne ut punktene som skal reverseres og dreies på rattet.

Den siste egenskapen til min ideelle bevegelsesgjenkjenning er at den definitivt må ha det tilsvarende flaggpunktet i operasjonen. Flaggpunktet kan være en regel, for eksempel å sette det til midten av øretelefonen og deretter flytte til høyre eller tilbakemelding, som en bølgehånd når du finner den RØDE lysdioden for sensorlys PÅ, eller skyv ned skjermen for å aktivere 3Dtouch når du kjenner vibrasjon av telefonen. Dette er alle funksjonene som jeg synes den perfekte gestgjenkjenningssensoren burde ha.

Trinn 1: La oss sammenligne tre sensorer for gjenkjenning av gest og vitne til den nye kongen

Oppsummer:

Pris

Gravity: Gesture & Touch Sensor: $ 9,9 RGB

Farge- og gestsensor for Arduino: $ 13,9 3D

Gesture Sensor (Mini) for Arduino: $ 13,9

Gravity: Gesture & Touch Sensor er den billigste

Prinsippet

Gravity -prinsippet: Gesture & Touch Sensor og RGB Color and Gesture Sensor er de samme, de er begge basert på en infrarød stråle. For å analysere den reflekterte IR -bølgen, bør sensorens deler utsettes for utsiden. Slik at du kan bruke gjennomsiktige materialer som akryl, PC og andre som skorpe. Og 3D Gesture Sensor (Mini) er basert på elektrisk nærfelt sensing teknologi. Det er flere valg og scenarier i skjell. Det kan fortsatt fungere normalt, til og med satt i et 2 mm ugjennomsiktig deksel.

Bevegelser

Gravity: Gesture & Touch Sensor er enestående for 7 praktiske bevegelser. Dessuten er 3D Gesture Sensor unik for bevegelsen med urviseren, som kan brukes på scenarier som lys-, farge- og volumjusteringer og så videre.

Anerkjennelsesområde

Gravity: Gesture & Touch Sensor er 20 cm som standard, og den kan justeres innen 0-30 cm. I tillegg til at den lengste gjenkjenningsavstanden er 30 cm, kan den justerbare gjenkjenningsavstanden slå andre i det hele tatt. Den justerbare gjenkjenningsavstanden kan unngå bevisstløse utløsere. Det kan øke stabiliteten og påliteligheten.

Kabling

Gravity: Gesture & Touch Sensor vedtar et 4 -pins Gravity -grensesnitt, plug and play, enkelt å koble til. Og det tar bare 2 IOer. Andre sensorer må koble en etter en og tar flere IOer enn den.

Andre

Gravity: Gesture & Touch Sensor har 5 berøringstaster. Og RGB farge- og bevegelsessensor har funksjon for detektering av omgivelseslys og avstandsmåling.

Trinn 2: Dimensjonssammenligning

Over er alle parametere sammenligning, og hvordan det føles å bruke? For å få deg til å identifisere deg med følelsene mine om å bruke disse gestgjenkjenningssensorene, formcrumble til overraskelse og forbauselse, vil jeg gjerne begynne med oblasjoner. RGB farge- og bevegelsessensor

Når du vinker normalt, er det spesielt hyppige gjenkjennelsesfeil - "INGEN".

Trinn 3: Da jeg vinket raskere

Da jeg vinket raskere, krasjer produktprøveprogrammet direkte og kan ikke gjenkjenne bevegelser (gif-diagrammet kutter antall bilder, så det ser bare veldig raskt ut, men faktisk bare litt raskere enn den vanlige bølgen, såkalt raskere).

3D gestusensor (mini) SEN0202

I prosessen med saktebølge-gjenkjenning er det mange situasjoner som ikke kan gjenkjennes. Jeg har vinket 10 ganger, men den gjenkjenner bare 4 vinker. I prosessen med å identifisere sirklene, tegnet jeg 6, 7 runder, men den gjenkjente bare 3 "CW". De første 3-4 sirklene er helt ugjenkjennelige, og de følgende kretsene kan identifiseres. Det tar 3-4 ganger før du får tilbakemelding i tide. Dessuten sender den ut to feilgjenkjenninger.

Endelig kommer helten alltid på scenen endelig, Gravity: Gesture & Touch Sensor kommer!

Slow-wave, kom igjen, bare en liten sak, gjenkjennelsesresultatet er veldig pålitelig.

La oss fokusere på avanserte tester. Dette er dataene som skrives ut i øvre og nedre gest-serie: Når hånden er innenfor 20 cm, vil pull-up og pull-down sende ut "opp" og "ned";

Hvis du trekker opp mer enn 20 cm, eller hvis bevegelsen trekkes og hånden trekkes tilbake, vises "trekk og fjern"

Har du sjokkert over ytelsen til Gravity: Gesture & Touch Sensor? Den ultra-raske bølgen, bølgehastigheten har nådd min grense, hendene mine er døde … Den intuitive følelsen av å bruke disse tre gestgjenkjenningssensorene er uansett hvor vanlig den tidligere gesten er, gest- og berøringssensoren er noe. Den kan brukes på hvilken som helst scene, enten det er kontrollen over hjemmebryterlysene eller kommersielt kroppsfølende interaktive enheter.

Trinn 4: Avslutningsvis

Gravity: Gesture & Touch Sensor er stort sett perfekt. Husker du fremdeles de tre funksjonene jeg nevnte før?

1. Vær pålitelig

Bølge i normal hastighet, hvor mange ganger jeg vinket til venstre og høyre, hvor mange den gjenkjente. Resultatet er ganske fantastisk.

2. Vær rask

Med hver glatte gest gjenkjenner den nesten den nåværende gesten uten forsinkelse, så raskt.

På dette grunnlaget, i den ultrahurtige bølgen av eksperimentet, kan styrken det bryter ut bare beskrives som sjokk. Jeg vinket så fort, men det fortsatte å gjenkjenne det uten å falle, og gjenkjennelsesnøyaktigheten er fortsatt så høy. Selv nå kan jeg fremdeles ikke finne ut grensen, så fantastisk!

3. Det tilsvarende flaggpunktet

Dessverre, Gravity: Gesture & Touch Sensor Jeg har ikke funksjonen som denne. Men hvis vi kan finne flaggpunktet fra de opprinnelige dataene og bruke en LED -indikator for den visuelle tilbakemeldingen, vil det bli gjort.

Trinn 5: Spillespill

1. Med den kraftige funksjonen trenger Gravity: Gesture & Touch Sensor ikke å være begrenset til gestgjenkjenning. Med muligheten til å gjenkjenne bevegelsesretningen, kan den fullt ut brukes som en håndhastighetssensor. Sett en skjerm på brødbrettet og vis håndbølgefrekvensen i displayet, din håndviftende kampanordning.

2. Fra anerkjennelsen av bølgehastigheten kan du gjøre spillinteraksjon. Ta den flygende fuglen som et eksempel, vinker raskt, så flyr fuglen høyt mens den vinker sakte og fuglen flyr lavt.

3. Liker du DJ -er? Dimitri Vegas og som Mike? Pauly D og Snake? Prøv å gjøre Gravity: Gesture & Touch Sensor til en platespiller.

4. Hvis du ikke liker håndflaten, kan du også gjøre det med en enkelt finger.

5. Hvis du føler at enhåndsoperasjon ikke er vanedannende, legg hendene sammen og vri sensoren i riktig vinkel.

Venstre hånd kontrollerer topp- og bunnsvingene, høyre styrer venstre og høyre svingning, og lar begge hendene være involvert.

Og hva slags interessant produksjon vil komme ut? Flere muligheter venter på deg å oppdage. Takk for at du leser!

Anbefalt:

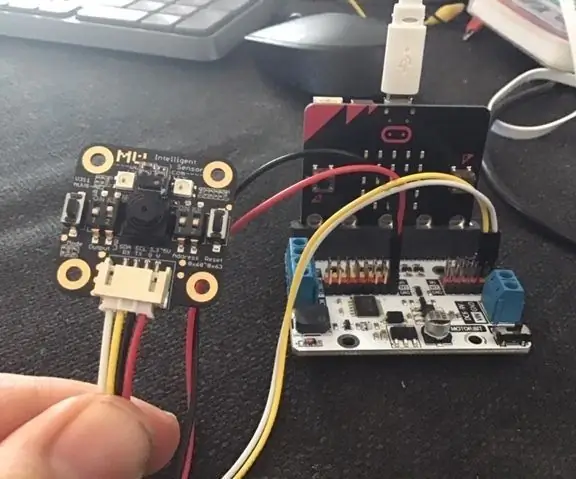

Micro: bit MU Vision Sensor for Beginners - I2C and Shape Card Recognition: 8 Steps

Micro: bit MU Vision Sensor for Beginners - I2C og Shape Card Recognition: Jeg har fått tak i en MU vision sensor for Micro: bit. Det ser ut til å være et kult verktøy som gjør at jeg kan lage mange forskjellige visjonsbaserte prosjekter. Dessverre er det ikke så mange guider til det, og selv om dokumentasjonen virkelig er

Star Recognition Using Computer Vision (OpenCV): 11 trinn (med bilder)

Stjernegjenkjenning ved hjelp av Computer Vision (OpenCV): Denne instruksjonen vil beskrive for deg hvordan du lager et datasynprogram for å automatisk identifisere stjernemønstre i et bilde. Metoden bruker OpenCV (Open-Source Computer Vision) -biblioteket til å lage et sett med trente HAAR-kaskader som kan

Raspberry Pi 4 Traffic Sign Recognition Robot: 6 trinn

Raspberry Pi 4 Traffic Sign Recognition Robot: Denne instruksjonsbasen er basert på universitetsprosjektet mitt. Målet var å lage et system der et nevralnettverk analyserer et bilde og deretter basert på gjenkjenningen vil fortelle en arduino -robot å bevege seg via Ros. For eksempel hvis et sving til høyre blir gjenkjent

Gesture Hawk: Hand Gesture Controlled Robot Using Image Processing Based Interface: 13 trinn (med bilder)

Gesture Hawk: Hand Gesture Controlled Robot Using Image Processing Based Interface: Gesture Hawk ble vist frem i TechEvince 4.0 som et enkelt bildebehandlingsbasert menneske-maskin-grensesnitt. Dens nytte ligger i det faktum at det ikke kreves flere sensorer eller bærbare unntatt en hanske for å kontrollere robotbilen som kjører på forskjellige

Snowmanthesizer - Thing a Day - Day 2: 8 Steps (med bilder)

Snowmanthesizer - Thing a Day - Day 2: Den andre kvelden klippet jeg endeløse ark med robotklistremerker for å gjøre alle barna lykkelige. Ja, bare kutte bort, tenke på min egen virksomhet, og akkurat da går vår fryktløse leder Eric i hendene på meg tre rare plastiske ting. Han informerer meg om